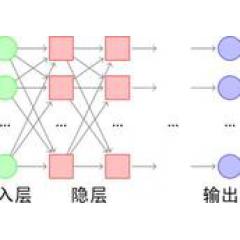

l'apprentissage machine avait des algorithmes d'apprentissage lorsqu'ils sont exposés ŕ une méthode de descente de gradient, qui est souvent utilisé en tant que formateur de l'algorithme de formation, parce que le gradient local dans la direction opposée est la plus forte baisse, il est facile de Converge. Il convient de noter que beaucoup de gens croient que le gradient de direction inverse est la plus forte baisse, et la compréhension de cet argument est ŕ sens unique, inexact, il est juste le plus rapide au niveau local, plutôt que globalement le plus rapide, de sorte que nous pouvons observer de nombreuses machines algorithme d'apprentissage souvent pris au pičge dans optimum local, comme algorithme de réseau de neurones BP.

Doit ętre gradient compris, premier ŕ partir du début dérivée directionnelle, le déflecteur on apprend avant que les moyens de numéros que le taux de changement de fonction le long d'un axe de coordonnées, mais nous sommes souvent préoccupés par le taux de variation d'une fonction de plusieurs variables de procédé suivant, puis conduit ŕ la dérivée directionnelle .

Nous directionnel rapport la distance dérivée f (x + Dx, y + dy) valeurs -f (x, y) de valeur1 et valeur2 PP1 PP1 le long de l'extremum est appelée.

La męme chose est vraie pour l'espace ŕ trois dimensions, dérivée directionnelle est d'étudier le taux de variation dans une direction quelconque ŕ un autre point de la dérivée directionnelle, gradient est pas une valeur, mais un vecteur, le vecteur qui est ce que le vecteur spécial il? C'est le gradient représente le nombre de chaque guide, la plus grande tendance dans cette direction.

Il est défini comme suit:

Ensuite, la relation entre la direction du gradient de la dérivée de ce qui suit:

Ainsi, la disposition, mais seulement lorsque [Theta] est de 0 degré lorsque la direction du dérivé maximale, [Theta] est de 180 degrés, la direction du dérivé négatif maximal, dans le sens opposé de sorte que le champ de gradient est une fonction de la plus forte baisse locale.